AIサーバーは、もういらない——5万円のRaspberry Pi、ブラウザ推論、個人PCで分散学習。「部品」が今週すべて揃った

Related Articles

「AIは高い」が終わった週

結論から言う。今週、3つのニュースが同時に出た。

- Raspberry Pi 5 + AI HAT+で、5万円のLLM実行環境が手に入る

- WebLLMで、ブラウザを開くだけでLLM推論ができる

- RoundPipeで、家庭用GPU数枚を束ねて分散学習ができる

この3つが揃ったことの意味は大きい。「推論」「デプロイ」「学習」——AIを回すために必要な3つの工程すべてで、高額なサーバーもクラウド課金も不要になる道筋が見えた。

月額数万円のAPI課金を払い続けるか、5万円の箱を買って自分で回すか。その選択肢が、地方の10人規模の会社にも開かれた。これは「AIが安くなった」というレベルの話ではない。AIインフラのコスト構造そのものが壊れ始めたという話だ。

—

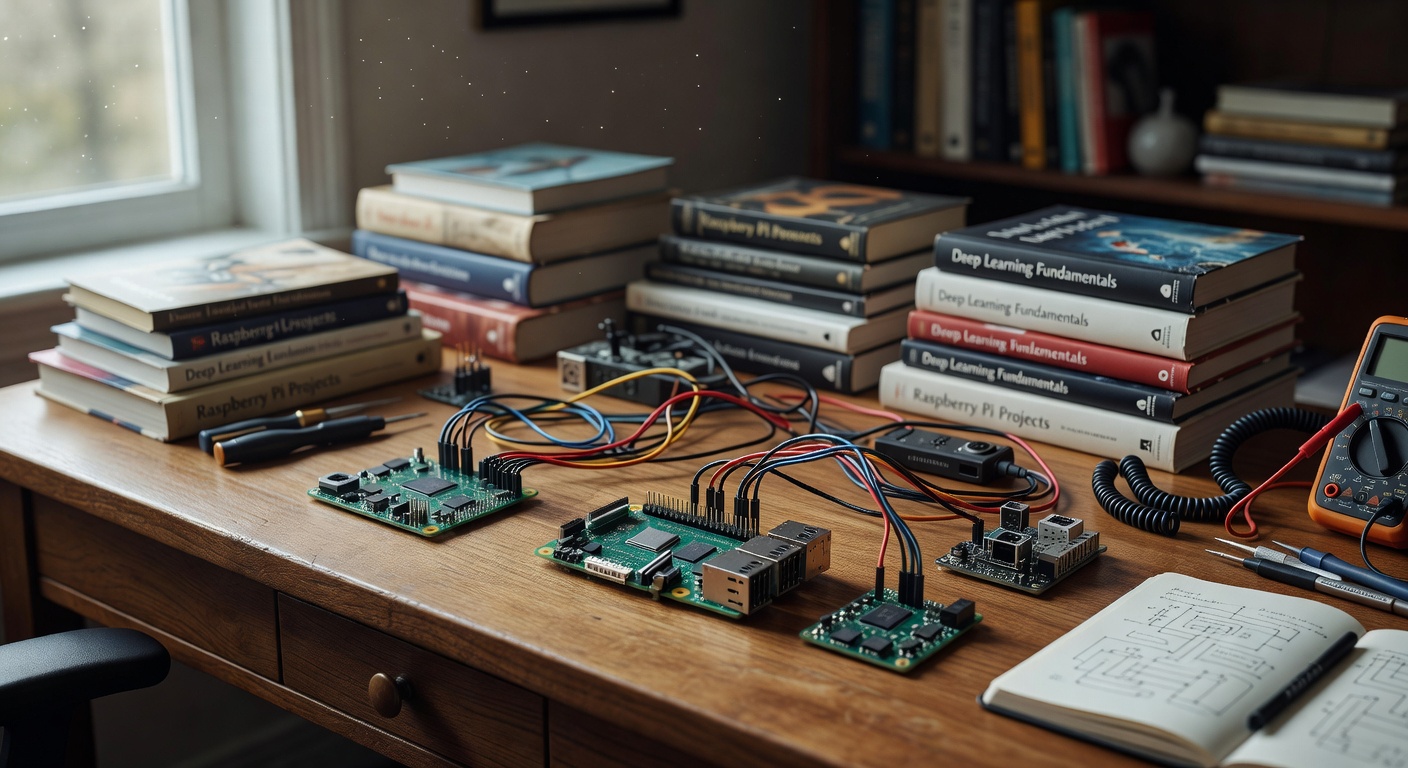

5万円で何が動くのか——Raspberry Pi 5 + AI HAT+の実力

まず事実を整理する。Raspberry Pi 5にHailo製のAIアクセラレータを搭載した「AI HAT+」を載せると、エッジ環境でLLMが動く。構成と価格はこうだ。

- Raspberry Pi 5本体: 約1万円

- AI HAT+(26 TOPS): 約3万円

- microSD・電源・ケースなど周辺: 約1万円

- 合計: 約5万円

名刺入れ程度のサイズの基板に、1秒あたり26兆回の演算能力が載る。数年前なら数十万円のGPUサーバーでやっていた処理だ。

もちろん制約はある。動かせるモデルサイズには限界があり、70Bクラスの巨大モデルをそのまま載せるのは現実的ではない。だが、7B〜13Bクラスの量子化モデルであれば実用的な速度で推論できる。社内FAQの応答、議事録の要約、定型文書のドラフト生成——中小企業の現場で「まず使いたい」用途の大半は、このレンジで十分カバーできる。

ここで考えるべきは「何ができるか」ではなく、何のコストが消えるかだ。

—

クラウドAIとの3年コスト比較——数字で見る逆転

中小企業がChatGPT APIやAzure OpenAIを業務利用する場合、月額2〜5万円程度のランニングコストは珍しくない。控えめに月2万円で計算してみる。

| 項目 | Raspberry Pi 5環境 | クラウドAI |

|---|---|---|

| 初期投資 | 約5万円 | 0円 |

| 月額コスト | 電気代のみ(数百円) | 約2万円 |

| 1年目の総コスト | 約5.5万円 | 約24万円 |

| 3年間の総コスト | 約7万円 | 約72万円 |

3年で65万円の差。これは従業員10人の会社にとって、無視できる金額ではない。しかもクラウドAIは使えば使うほど課金が増える従量モデルだが、自社環境は使い放題だ。深夜にバッチ処理を回しても、休日に実験しても、追加コストはゼロ。

さらに見落とされがちなのがデータの問題だ。クラウドAPIに社内文書を投げるたびに、データが外部に出る。個人情報、取引先情報、ノウハウ——地方の中小企業ほど「顔が見える関係」で商売しているから、情報漏洩リスクへの感度は高い。自社のRaspberry Piで完結するなら、データは一切外に出ない。これは数字に表れないが、現場の安心感として極めて大きい。

—

ブラウザを開くだけでAI——WebLLMが変えるデプロイの常識

次に、WebLLMの話をする。これはブラウザ上でLLMの推論を実行するエンジンだ。WebGPU APIを活用し、ユーザーのローカルマシンのGPUでモデルを動かす。

何が革命的かというと、「AIをデプロイする」という概念が消えることだ。

従来、社内にAIツールを導入しようとすると、サーバーを立て、APIを設計し、フロントエンドを作り、認証を組み、運用監視を設定する——という工程が必要だった。中小企業がこれをやるには、外注で数百万円、内製でも数ヶ月かかる。

WebLLMなら、社員がChromeを開いてURLにアクセスするだけでいい。インストール不要。サーバー不要。IT担当者が「全員のPCにソフトを入れて回る」必要もない。

もちろん、ブラウザ内推論の速度はネイティブ実行に比べれば落ちる。だが「速度が少し遅い代わりに、導入コストがゼロになる」というトレードオフは、多くの現場で十分に成立する。

中小企業にとって最大のボトルネックは、AIの性能ではない。導入の手間だ。 WebLLMはそこを根こそぎ消しにかかっている。

—

個人PCのGPUを束ねて学習する——RoundPipeの衝撃

3つ目。これが一番地味に見えて、一番構造を変える可能性がある。

RoundPipeは、複数のコンシューマGPU(GeForce RTX 4090など)をネットワークで接続し、大規模モデルの学習を効率的に分散処理するパイプラインスケジュールだ。

論文の数字を引く。RTX 4090を8枚使い、1.7Bから32Bパラメータのモデルをファインチューニングした場合、既存手法と比較して1.48〜2.16倍のスループット向上が確認されている。

これの何がすごいかというと、「学習」というAIで最もコストがかかる工程が、クラウドのA100/H100を借りなくても、そこそこ戦えるレベルになりつつあるということだ。

RTX 4090は1枚約25万円。8枚で200万円。高いと思うかもしれない。だが、NVIDIA H100を8枚クラウドで借りると、時間単価で数千円〜1万円、月額で数百万円になる。200万円の初期投資で、毎月数百万円の課金から解放される。回収は数ヶ月だ。

もちろん、最先端の数百Bパラメータのモデルをゼロから事前学習するのは現実的ではない。だが、中小企業がやりたいのは「自社データで7B〜13Bモデルをファインチューニングする」ことだ。自社の業界用語を理解させる、自社の過去の提案書のトーンで文章を生成させる——このレベルなら、RTX 4090数枚で十分に射程圏内に入る。

—

3つが揃うと何が起きるか——「AIの自給自足」という選択肢

ここまでの3つを組み合わせると、こういう絵が描ける。

- RTX 4090数枚で自社データを使ってモデルをファインチューニング(学習)

- できたモデルをRaspberry Pi 5 + AI HAT+に載せて社内サーバーとして稼働(推論)

- 社員はブラウザからWebLLM経由でアクセス、またはローカルで直接利用(デプロイ)

サーバールーム不要。クラウド契約不要。IT部門不要。月額課金不要。

AIの「自給自足」だ。

これは大企業には響かない話かもしれない。彼らには潤沢なIT予算があり、専任のMLエンジニアがいる。だが、地方の製造業、建設会社、士業事務所、小売チェーン——こうした「IT予算が年間100万円以下」の世界では、この構造変化は決定的な意味を持つ。

今まで「AIは大企業のもの」だった。それが「5万円の箱と、ブラウザと、ゲーミングPC」で回る世界になる。

—

で、結局どうすればいいのか

「面白いのはわかった。で、うちは何から始めればいい?」

こう聞かれたら、答えはシンプルだ。

ステップ1: Raspberry Pi 5 + AI HAT+を1台買って、社内で触れる人間を1人作る。投資5万円。

量子化済みの7Bモデル(Llama 3.1 8Bなど)を載せて、社内の定型業務——メール下書き、議事録要約、FAQ応答——を1つだけ自動化してみる。

ステップ2: 効果が出たら、自社データでのファインチューニングを検討する。

RTX 4090搭載のPCを1台用意し(約40万円)、LoRAで軽量にチューニングする。外注すれば数百万円かかる「自社専用AI」が、自前で作れる。

ステップ3: WebLLMで社内展開する。

ブラウザベースなら、ITリテラシーが高くない社員でも使える。「全員がAIを使える状態」を、追加コストほぼゼロで実現できる。

重要なのは、最初から完璧を目指さないことだ。5万円で始めて、効果が見えたら次に進む。見えなければ撤退しても5万円の損失で済む。クラウドAIの年間契約を結んでから「使われませんでした」となるのとは、リスクの桁が違う。

—

これは「AIの地方分権」の始まりだ

東京の大企業がGPUクラスタを積み上げ、数億円のAI投資を発表するニュースが毎週流れてくる。あれはあれで正しい戦い方だ。だが、あの土俵で戦う必要はない。

5万円の箱で、自社のデータだけを使い、自社の業務だけに特化したAIを、自社の中だけで回す。データは外に出さない。月額課金もない。壊れたら買い替えればいい。

大企業が「AIに何百億円投資した」と言っている横で、地方の町工場が5万円でAIを回している。 そういう未来の部品が、今週すべて揃った。

あとは組み立てるだけだ。まず1台、買ってみてほしい。

—

JA

JA EN

EN